IT

Google, Microsoft i xAI omogućiće američkoj vladi rani pristup AI modelima

Tri tehnološka giganta potpisala dogovor sa američkom vladom o ranom testiranju naprednih AI sistema, u svetlu novih regulatornih inicijativa

g36c76d7059c1daaf84c0a59611b64435455dfd65b77119c7dd25737cd81b490e944f3c40c8c626aeeac0ce991929cfc8e5dc31454b91bbea3e4d949f692c71fa_1280

g36c76d7059c1daaf84c0a59611b64435455dfd65b77119c7dd25737cd81b490e944f3c40c8c626aeeac0ce991929cfc8e5dc31454b91bbea3e4d949f692c71fa_1280

IT

AI prevara putem telefona: Kloniranje glasova postaje sve veći bezbednosni izazov

Kriminalci koriste veštačku inteligenciju za imitaciju glasova porodice i prijatelja, otežavajući prepoznavanje prevare

IT

Elon Musk postigao nagodbu sa SEC-om zbog ulaganja u Twitter, plaća 1,5 milion dolara

Nagodba okončava višegodišnji spor oko pravovremenosti objave o kupovini akcija Twitter-a

IT

Bela kuća razmatra strožu regulaciju novih AI modela zbog bezbednosti

Moguće formiranje posebne federalne radne grupe za nadzor razvoja veštačke inteligencije u SAD

-

Srbija21 hours ago

Srbija21 hours agoZabranjeno parkiranje automobila i kamiona na autobuskim mestima kod Würenlosa, kazne do 2.165 evra

-

Domaće23 hours ago

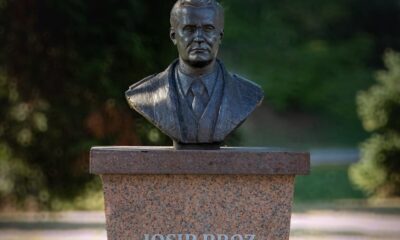

Domaće23 hours ago“Ako mi odseku nogu, sam ću sebi presuditi!” Titov lični lekar otkrio jezivu tajnu: Sklonili smo mu pištolj iz torbice, a ubila ga je jedna kobna greška!

-

Žena Stil21 hours ago

Žena Stil21 hours agoNajzapaženiji modni trenuci sa predžurki Met Gale 2026

-

Domaće22 hours ago

Domaće22 hours agoMuškarac preminuo nakon pada u kanal na tehničkom pregledu u Mladenovcu

-

Ostali sportovi24 hours ago

Ostali sportovi24 hours agoAndrea Kimi Antonelli dominantan u Majamiju, Mercedes pod pritiskom nakon promena u F1 šampionatu

-

Domaće18 hours ago

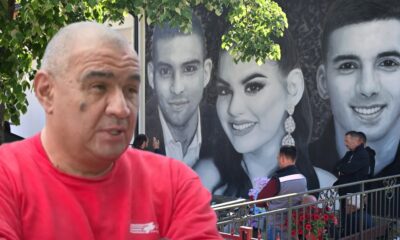

Domaće18 hours agoMasovno ubistvo u Duboni i Malom Orašju, devetoro mladih izgubilo život

-

Ishrana21 hours ago

Ishrana21 hours agoKako sačuvati mekoću i vazdušnost palačinki i za naredni dan

-

Košarka20 hours ago

Košarka20 hours agoZvezdan Mitrović pred četvrtfinale ABA lige: Crvena zvezda je izuzetno snažan protivnik